この記事でわかること

- ローカルAIとは何か

- Ollama・LM Studio・Janの違い

- 初心者が最初に確認すべきPC条件

- 8GB・16GB・32GBメモリで狙いやすい使い方

- オフライン利用とプライバシー面の注意点

- 最初にどのツールから試すべきか

この記事で判断できること

- 自分はOllama・LM Studio・Janのどれから始めるべきか

- 今のPCでローカルAIを試せるか

- GPUなしでも始めてよいか

- PCや周辺機器を見直すべきか

- ローカルAIをメイン利用にできるか、補助利用にとどめるべきか

ローカルAIとは何か

ローカルAIとは、AIモデルをクラウド上ではなく、自分のPCや手元の環境で動かす使い方です。

ChatGPTやClaudeのようなクラウドAIは、インターネット経由でサーバー上のAIに質問する仕組みです。一方、ローカルAIは、モデルをPCにダウンロードして、そのPC上で推論(回答の生成)を行います。

ローカルAIの主な魅力は、月額コストの見直し、プライバシー面の安心感、オフラインに近い環境で使えることの3点です。

ただし、「ローカルAIなら何でも無料」「クラウドAIは不要」と考えるのは少し早いです。モデルのダウンロード、アップデート、追加機能の取得、クラウド連携では通信が必要になることがあります。また、PC性能が足りないと、回答が極端に遅い、モデルが読み込めない、動作途中でフリーズするといった問題も起きやすいです。

ローカルAIは、クラウドAIの完全な代替というより、用途に応じて使い分ける選択肢と考える方が、実際の運用に近いです。

Ollama・LM Studio・Janの違い

ローカルAIを始めるとき、よく比較されるのがOllama、LM Studio、Janです。

大きく分けると、次のような違いがあります。

- Ollama

CLI(コマンド入力で操作する形式)やAPI(外部ツールと接続するための入口)連携に強く、開発・自動化まで広げやすい - LM Studio

GUIで操作しやすく、モデル検索やチャットを画面上で進めやすい。個人・非商用利用での無料利用が前提 - Jan

オープンソース志向で、GUI、ローカルAPI、MCP(AIと外部ツールをつなぐ仕組み)など拡張性も意識しやすい

| ツール | 操作性 | 向いている人 | API連携 | 初心者向け度 | 注意点 |

|---|---|---|---|---|---|

| LM Studio | GUI中心 | 画面で直感的に試したい人 | ローカルサーバーとして利用可 | ★★★★ | 個人・非商用は無料。商用はライセンス確認が必要 |

| Jan | GUI+拡張 | GUIで始めつつ後から広げたい人 | OpenAI互換API・MCP対応 | ★★★ | 設定の自由度が高い分、初期設定に手間がかかることがある |

| Ollama | CLI中心 | コマンド操作に慣れている人 | ローカルAPI・外部ツール連携 | ★★ | CLIに不慣れだと最初の敷居が高め |

Ollamaが向いている人

Ollamaは、コマンド操作やAPI連携に抵抗が少ない人に向いています。

最初は少し難しく見えるかもしれませんが、将来的にローカルAPI、自動化、外部ツール連携まで広げたい場合は有力な選択肢です。LinuxやmacOSではとくに動作が安定しやすく、開発環境との相性も良い場面が多いです。

LM Studioが向いている人

LM Studioは、画面を見ながらローカルAIを試したい人に向いています。

モデルを探す、ダウンロードする、チャットする、ローカルサーバーとして使う、といった流れをGUI中心で進めやすいのが特徴です。初めてローカルAIを触る人には、最初の候補にしやすいツールです。

なお、個人・非商用利用では無料で使えますが、商用目的で利用する場合はライセンス条件を事前に確認してください。

Janが向いている人

Janは、オープンソースのChatGPT代替のような位置づけで使いたい人に向いています。

ローカルモデルだけでなく、クラウドAIとの接続、カスタムアシスタント、OpenAI互換API、MCP連携なども視野に入ります。GUIで始めつつ、後から広げたい人に合います。完全オープンソースという特性上、将来的な機能拡張にも期待しやすいです。

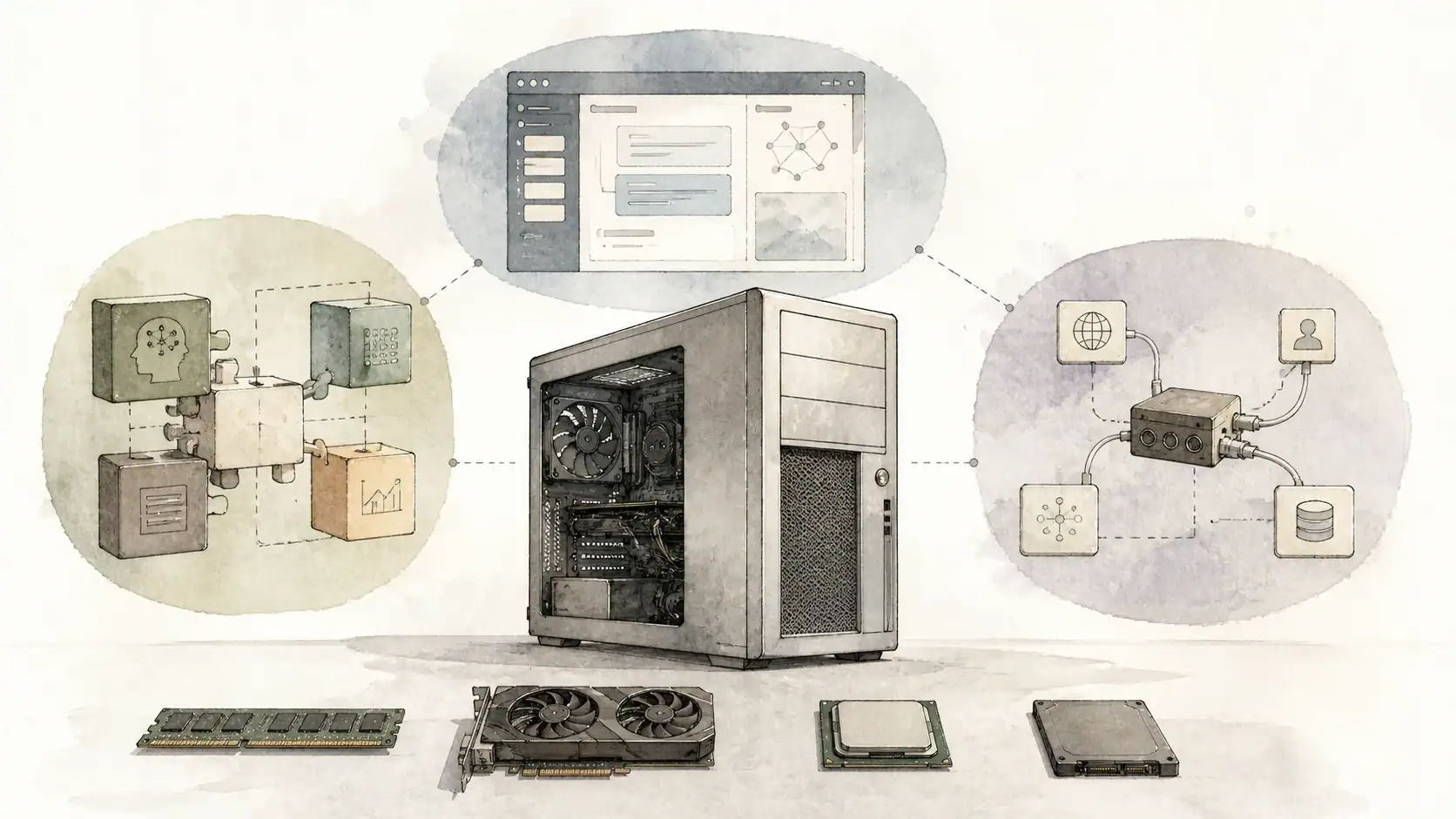

初心者が最初に見るべきPC条件

ローカルAIで最初に見るべきなのは、ツール名よりもPC条件です。

特に大事なのは、次の4つです。

- RAM

PC全体の作業用メモリです。ローカルAIではとくに重要な項目で、モデルをメモリに読み込む必要があります - VRAM

GPU(グラフィックカード)側のメモリです。十分にあると処理が速くなりやすいです。GPU非搭載の場合はCPUとRAMで補います - CPU

WindowsではAVX2という命令セットへの対応が条件になるツールがあります - ストレージ

モデルファイルは数GBから十数GBになることがあります。空き容量は余裕をもって確保してください

注意点

「インストールできる」と「快適に使える」は別です。

8GB RAMでも軽量モデルなら試せる場合がありますが、快適さを考えると16GB RAMが現実的な入口です。32GB以上あると、選べるモデルや作業の余裕が増えます。

| RAM | 現実的な用途 | 注意点 |

|---|---|---|

| 8GB | 軽量モデルで短文チャット・簡単な下書き | 他のアプリを開いた状態では動作が重くなりやすい |

| 16GB | 軽量〜中型モデルで要約・アイデア出し・コード補助 | 大きなモデルや長文処理では余裕がなくなることがある |

| 32GB以上 | 7B・13Bクラスのモデルや長文処理にも挑戦しやすい | GPUやVRAMも揃っていると体験がより安定しやすい |

8GB RAMの場合

8GB RAMでは、軽量モデルを短い文章で試す程度が現実的な範囲です。

雑談、短文の要約、簡単な下書き作成なら試せる可能性はあります。ただし、長いPDF処理、長文資料の読み込み、複数アプリを開いた状態での利用には向きません。「とにかく一度動かしてみたい」という確認目的なら8GBでも試せますが、継続利用を前提にするなら早めに16GBへの移行を検討すると良いです。

16GB RAMの場合

16GB RAMは、ローカルAIを試す現実的な入口です。

軽量から中型のモデルを使い、短めの文章生成、要約、アイデア出し、簡単なコード補助などを試しやすくなります。ただし、大きなモデルや長い文脈を扱う場合は重くなることがあります。最初は軽量モデルやQ4系量子化から始めると失敗しにくいです。

32GB RAM以上の場合

32GB以上あると、ローカルAIの選択肢が大きく広がります。

7B、13Bクラスのモデルや、少し長めの文書処理にも挑戦しやすくなります。GPUやVRAMも十分にある場合は、より快適な環境を作りやすいです。Apple Silicon Mac(M1以降)は、RAM・VRAM・CPU処理が統合されているため、同じ16〜32GBでもWindowsより動作が安定しやすい場面があります。

オフライン利用とプライバシーの考え方

ローカルAIは、モデルをダウンロードした後の推論を手元のPCで行える点が強みです。

たとえば、日記、社外に出したくないメモ、議事録の下書き、個人的な調査メモなどは、クラウドに送らずに扱える可能性があります。

ただし、オフラインといっても、すべての場面で通信が不要とは限りません。

- モデル検索・ダウンロード

- アプリ更新

- 追加ランタイムの取得

- クラウドAIとの連携機能を使う場合

これらの場面では通信が発生することがあります。

重要プライバシー面で安心しやすいのは、推論がローカルで行われる場面に限ります。外部連携機能やクラウドモデルを有効にした場合は、ローカル完結ではなくなる可能性があります。

会社資料や個人情報を扱う場合は、どのモデルを使うか、どの機能をONにしているか、クラウド連携を使っていないかを確認することが大切です。

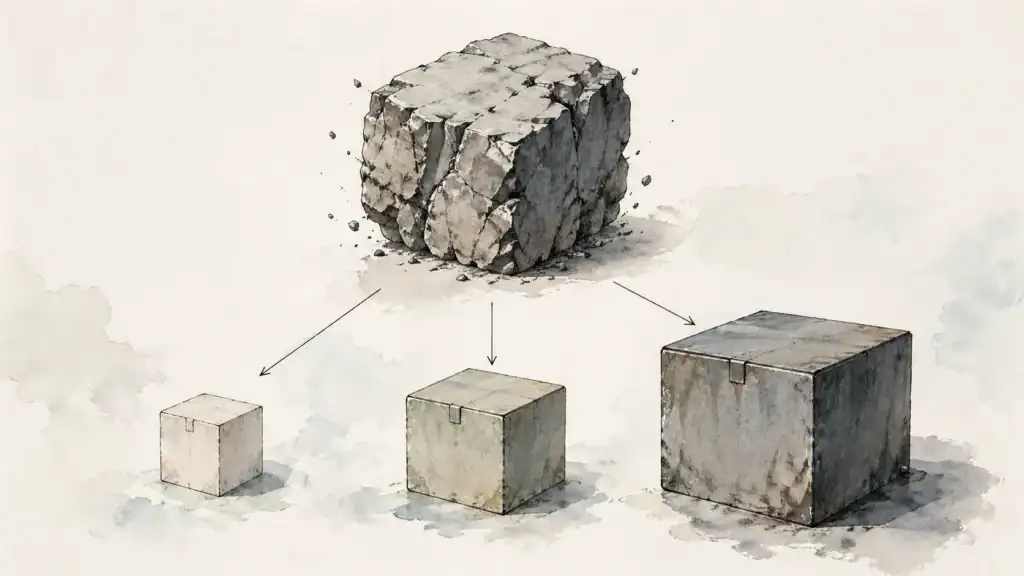

量子化をざっくり理解する

ローカルAIでよく出てくる「Q4」「Q5」「Q8」は、量子化の種類を表す言葉です。

量子化とは、AIモデルを軽くして、PCで動かしやすくするための圧縮のような考え方です。軽くなるほど動かしやすくなりますが、タスクによっては回答の精度や一貫性に差が出やすくなります。

ざっくり見るなら、次のように考えるとわかりやすいです。

- Q4系

軽さと品質のバランスを取りやすい。最初に試しやすい量子化 - Q5系

Q4より少し重くなるが、精度を少し重視したい場合に候補 - Q8系

品質寄りだが重くなりやすい。PCに余裕がある人向け - Q2・Q3系

メモリが厳しい場合の妥協案。回答の質が落ちやすい点は留意が必要

初心者が最初に試すなら、7B前後のモデルでQ4系を選ぶと、重すぎず失敗しにくい場合があります。

結局どれから始めるべきか

ローカルAIは、「どれが最強か」ではなく、「今何をしたいか」「自分のPCスペックはどの程度か」で選ぶ方が失敗しにくいです。

GUIで楽に始めたい場合

まずはLM Studioが候補です。

画面上でモデルを探し、ダウンロードし、チャットまで進めやすいため、ローカルAIの感覚をつかみやすいです。個人・非商用利用での無料利用が前提です。

オープンソースや拡張性も重視したい場合

Janが候補です。

GUIで使いやすく、ローカル保存やOpenAI互換API、MCPなども意識しやすいため、後から広げたい人に合います。完全オープンソースなので、特定サービスへの依存を避けたい人にも向いています。

API連携や自動化を見据える場合

Ollamaが候補です。

コマンド操作に抵抗がなければ、ローカルAPI、外部ツール連携、開発用途に広げやすいです。将来的にAIエージェントや自動化ワークフローへ発展させたい人は、最初からOllamaで慣れておく選択肢もあります。

初心者向け補足:よくある疑問

GPUなしでも使えますか?

使える場合はあります。

ただし、CPUだけだと回答速度が遅くなりやすいです。まず軽量モデルで試し、遅さが気になる場合はGPUやVRAMのあるPCを検討する流れが現実的です。Apple Silicon Macは、CPU・GPU・メモリが統合されているため、GPUを別途搭載していなくてもローカルAIの動作が安定しやすい特性があります。

16GB RAMで足りますか?

試す入口としては現実的です。

ただし、大きなモデル、長文処理、複数アプリ同時利用では余裕がなくなることがあります。最初は軽量モデルやQ4系から試すのがおすすめです。

MacとWindowsではどちらが始めやすいですか?

Apple Silicon Mac(M1以降)は、メモリをCPUとGPUが共有する設計のため、ローカルAIとの相性が良い場面があります。一方、WindowsはGPUの選択肢が広い反面、AVX2対応の確認、GPUドライバの整備、VRAM条件の確認が必要になるケースがあります。

どちらが絶対に有利というより、手元のPC条件と使いたいツールの要件を確認することが大切です。

ローカルAIなら完全無料ですか?

必ずしもそうとは言い切れません。

アプリやモデル自体を無料で試せる場合はありますが、PC購入、メモリ増設、SSD増設、電気代、学習コストなどは別途かかる可能性があります。LM Studioは個人・非商用利用での無料利用が前提であり、商用目的では有料ライセンスが必要です。

モデルライセンスは気にする必要がありますか?

個人で手元利用するだけなら大きな問題になりにくい場合があります。

ただし、モデルを再配布する、商用サービスに組み込む、顧客向けに提供する場合は、モデルごとのライセンス確認が必要です。

導入前チェックリスト

- PCのRAMは8GB・16GB・32GBのどれかを確認する

- GPUとVRAMの有無を確認する

- Windowsの場合はAVX2対応を確認する

- 空き容量が最低でも数十GBあるか確認する

- 最初は軽量モデルを選ぶ

- Q4系など、軽めの量子化モデルから試す

- クラウド連携を使うか、ローカルのみで使うか決める

- LM Studioを商用目的で使う場合はライセンスを確認する

- 商用利用や配布を考える場合はモデルライセンスを確認する

まとめ

ローカルAIは、クラウドAIの代わりというより、手元でAIを動かす選択肢です。

月額コストを見直したい人、個人的な文章や資料を外に出したくない人、PC環境を使ってAIを試したい人には魅力があります。

一方で、PC性能、モデルサイズ、量子化、GPU条件、ライセンス、通信が必要な場面など、見落としやすい点もあります。

最初の選び方は、次のように考えると整理しやすいです。

- GUIで楽に始めたい

→ LM Studio

https://lmstudio.ai/ - GUIと拡張性を両方見たい

→ Jan

https://jan.ai/ - API連携や自動化まで考えたい

→ Ollama

https://ollama.com/

まずは、今のPCのRAM・GPU・空き容量を確認し、軽量モデルのQ4系から試すのがおすすめです。

関連記事

AI検索ツール比較|ChatGPT・Perplexity・Gemini・通常検索の使い分けを整理

ローカルAIと並行してクラウドAI検索ツールも使い分けたい方に。よろしければご確認ください。

NotebookLMの使い方|PDF・URLをアップロードして「使える情報」に変える手順と活用のコツ

クラウド側で資料整理をしたい方に。ローカルAIとの使い分け参考にもなります。よろしければご確認ください。

AI初心者が最初に使いたい5つのツール【2026年版・無料から試しやすい】

ローカルAI以外のAIツールから始めたい方に。クラウドAI含む全体像が整理されています。よろしければご確認ください。

naked

事業所の運営に携わりながら、業務効率化のためにAIツールやアプリを日々試作・活用しています。

AIの学習を本格的に始めたのは2024年9月。

オンラインスクールで学び始めたものの、「これは自分が本当に必要な情報なのか?」という疑問がぬぐえず、独学に切り替えました。

自分で情報を集め、実際に使いながら学んできたからこそ、初心者がつまずきやすいポイントや「実際のところどうなの?」というリアルな視点に気づきやすい。

そういった視点を大切に、記事を書いています。

現在はAI活用を事業の柱として育てていくべく、資格取得に向けて勉強中。

今後はオンライン・オフラインを通じて、初心者や中高齢者の方へAIの便利さをわかりやすく届けていくことを目指しています。

コメント